人工智能(AI)成為社會新趨勢,活用於各行各業之中,的確為生活帶來唔少便利。不過凡事有利有弊,最近就有騙徒利用AI深偽技術,透過實時換臉換聲,製作虛假新聞報道以誘騙市民參與不實嘅投資活動,甚至移花接木後製影片,以勒索及詐騙受害人及其親友。

============

同場加映:

【家居達人】專家分享床單小知識! 點樣揀床單?清洗方法+次數?

============

警方早前接獲兩宗騙徒利用人工智能及深偽技術進行詐騙活動,其中一宗指有不法分子透過深偽技術製作虛假新聞報道,並冒認為香港銀行高層,借以推銷虛假投資計劃。有一名日本男子受騙,並向騙徒轉帳1,700港元嘅點數卡。

另一宗案件涉及本港一名25歲男子,男子接聽咗來歷不明嘅視像通話,對方以進行裸聊對話誘使佢下載拍定嘅手機直播App,其間盜取個人聲音及臉部訊息,並移花接木到色情片段,勒索要求購買1萬元點數卡。最終事主有感疑惑,未有受騙。

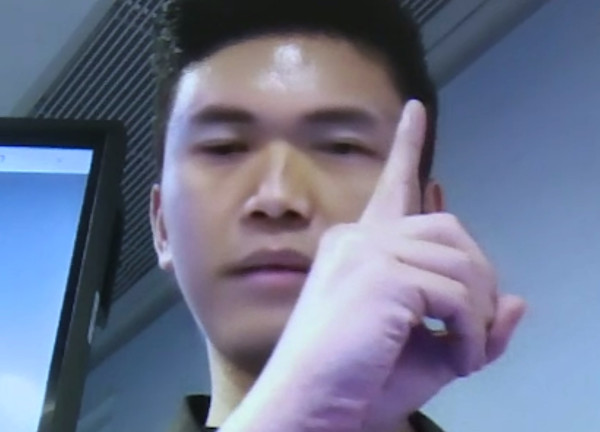

警方網絡安全組高級督察陳智穎指出,深偽技術並唔完美,要破解呢類詐騙手段,可以留意影片中嘅人物眼神同口型會唔會有唔自然嘅地方,也可以要求對方喺鏡頭面前舉起手指,慢慢橫過面部,由於電腦需要針對突如其來改變而重新運算,所以係會有穿崩位。

商業罪案調查科反詐騙協調中心高級督察張文瀚呼籲市民切勿輕易接聽陌生視像電話,以防個人生物辨識資料外洩。如擔心唔小心接聽呢類電話,可以預先喺電話中關掉FaceTime功能,有需要先再啟用。

Text/ Bee

Source/ HKET圖片庫

搵好去處

搵好去處