【AI睇症 / ChatGPT / 醫療健康 / 牛津大學 / 科技熱話2026】以前香港人「有病問 Google」,現在大家都進化到「有病問 AI」!不少人身體不適時,第一步不是預約醫生,而是把症狀輸入 AI 聊天機械人尋求初步診斷。不過,一項最新研究警告,依賴 AI 睇症可能會得出截然不同、甚至危及生命的錯誤建議!而最令人驚訝的是,出錯的元兇非並 AI 本身,而是因為「用家唔識問問題」?

牛津大學實測:僅33%人成功認出病症

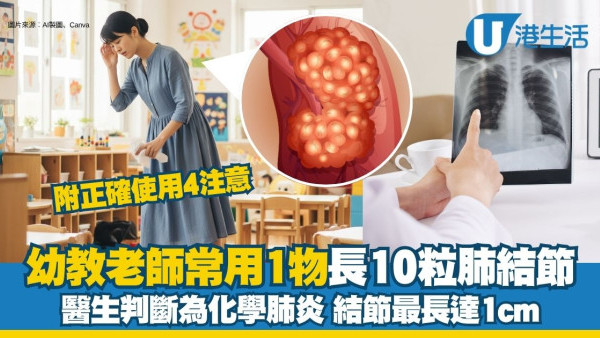

著名醫學期刊《自然醫學》(Nature Medicine)早前發表了一項由英國牛津大學進行的研究。研究人員向受試者提供了一些真實的醫療症狀案例,並要求他們向 ChatGPT 進行「問診」。

結果發現,在與 AI 進行對話後,竟然只有三分之一(33%)的受試者能正確識別出病症;更危險的是,只有 43% 的人能針對下一步行動(例如:應該立刻去急症室,還是留在家中休息)作出正確決定。

致命的「表達盲點」:少講一句隨時無命

雖然有其他研究證明,AI 模型的醫學知識儲備絕對不輸人類醫生,但為何在實際應用時卻錯漏百出?研究人員一針見血地指出:問題在於一般人根本不懂得如何「精準描述」自己的症狀。

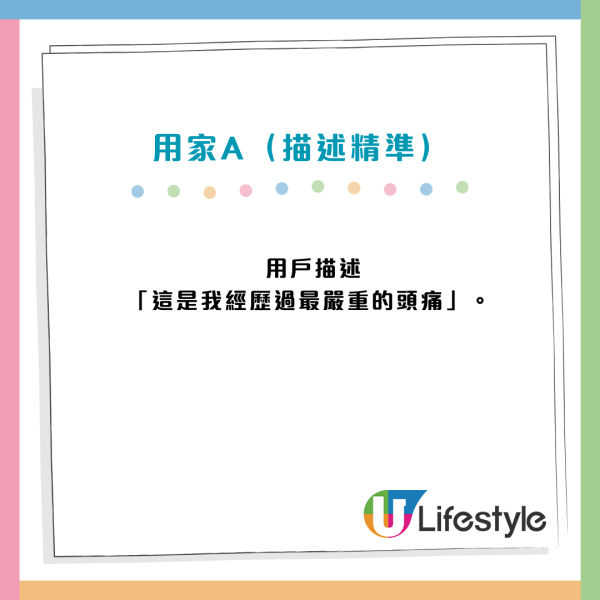

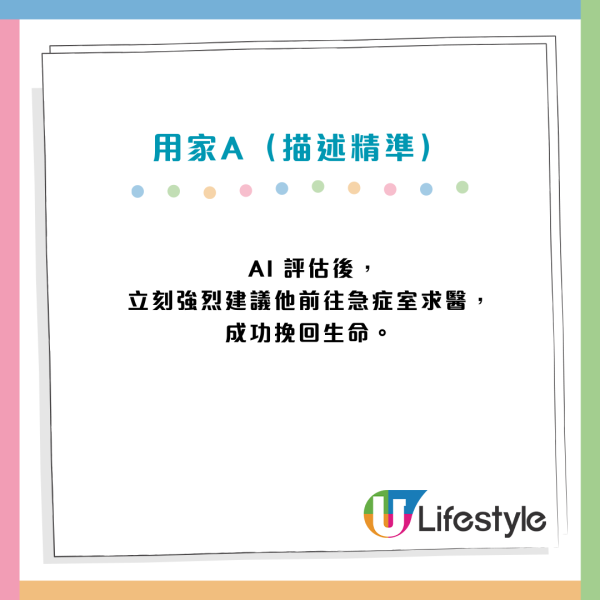

研究中展示了一個極度危險的實驗場景。兩位使用者同時遇上了一種危及生命的突發隱疾,但因為他們輸入給 AI 的字眼略有不同,結果卻是天淵之別:

醫生受過訓練 懂得「引導」病人

專家解釋,使用 AI 的成效,完全取決於「提問的質素(Prompting)」。在真實的診所裡,醫生受過專業的臨床訓練,當病人說「我頭痛」時,醫生會懂得主動追問:「痛法係點?有冇作嘔?視力有冇模糊?」從而找出病人遺漏了的關鍵資訊。

然而,AI 聊天機械人往往只會被動地根據用家提供的有限字眼去作答,這容易給予用家一種「虛假的安全感」,以為自己真的無大礙而錯失治療黃金期。

必學!問AI睇症3大正確Prompt

1. 交代完整背景(切忌當 AI 識讀心)

AI 不知道你的病歷,所以第一句必須「報上名來」。

致命問法:「我個頭好痛,係咩事?」

✅正確 Prompt:「我是一名 [年齡] 歲的 [性別],過往 [有/沒有] 長期病患(如高血壓/糖尿病)或藥物敏感。我現在出現 [病徵]。」

2. 具體描述症狀與時間(越細節越準確)

模糊的形容詞會令 AI 產生幻覺(Hallucination)並亂估。

致命問法:「我肚痛咗好耐,點算好?」

✅正確 Prompt:「我的 [具體位置,例如:右下腹] 出現了 [痛楚性質,例如:陣痛/刺痛/悶痛],這種情況已經持續了 [時間,例如:3天],並伴隨 [其他症狀,例如:發燒/作嘔/無胃口]。」

3. 強制 AI「戴頭盔」(設定安全底線)

這是最重要的一步!明確限制 AI 不要扮演權威醫生,而是提供客觀分析。

✅必加保命 Prompt:「請以『一般醫療衛教知識』的角度,為我分析以上症狀的幾種潛在可能性。同時,請清楚列出在什麼『危險警號(Red Flags)』出現時,我必須立即到急症室求醫。我明白你不是真正的醫生,稍後我會尋求專業的醫療意見。」

醫生總結:AI只能做「事前準備」

雖然 AI 問診存在風險,但多位醫學專家依然肯定它的價值。加州大學及哈佛醫學院的醫生均表示,從 AI 獲得的醫療建議,絕對好過你「聽遠房親戚亂教」。

他們建議市民,可以將 AI 視為見醫生前的「預習工具」,幫助自己更充分了解可能面對的狀況,以便在診症時更有效地與醫生溝通。但千萬要記住:「AI 絕對不能取代醫生」。對於沒有醫學背景的普通人來說,最終的診斷與治療方案,還是必須交由專業的醫護人員。

資料及圖片來源:《自然醫學》Nature Medicine、綜合外媒報道

逾4成港青陷重度抑鬱!中大揭當AI係醫生反加劇病情 專家警告死頂惹禍教3招自救

香港人生活壓力大到爆煲!最新調查發現,港人抑鬱及焦慮指數創下歷年新高,Gen Z 更成重災區,逾4成人陷入中重度抑鬱 ,而且不少人當 AI 是「樹洞」傾訴,究竟依賴 AI 會否令人中伏反令病情加劇 ?即看下文拆解這個潛藏危機!

搵好去處

搵好去處